Era só uma investigação sobre crimes graves na dark web. Mas de repente, ela cruzou com algo que ninguém esperava: o uso do ChatGPT. Agora, pela primeira vez, a OpenAI se viu no centro de uma investigação criminal, com um mandado federal solicitando nada menos do que o histórico de prompts de um usuário.

Sim, estamos falando de um caso real. E sim, isso levanta questões sérias sobre privacidade, vigilância e até onde a inteligência artificial pode (ou deve) ir em investigações.

O que aconteceu exatamente?

Em julho, um mandado de busca foi revelado em Maine, nos Estados Unidos. A Divisão de Investigações de Segurança Interna (HSI), que faz parte do ICE (Immigration and Customs Enforcement), solicitou oficialmente à OpenAI informações completas sobre um usuário suspeito de administrar um site de exploração infantil na dark web.

Entre os dados exigidos estavam:

- Histórico completo de conversas com o ChatGPT

- Nome da conta

- E‑mail de cadastro

- Dados de pagamento e IPs usados

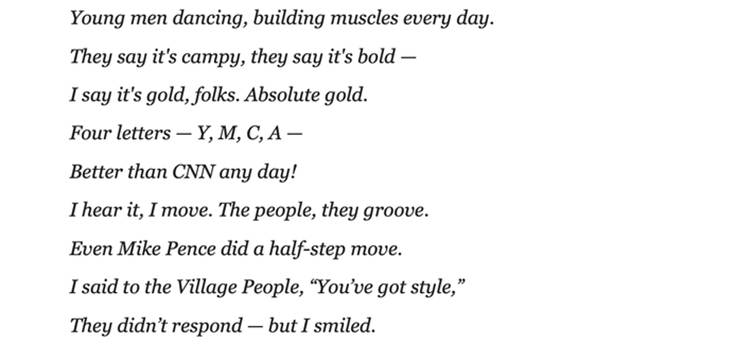

Tudo começou quando agentes disfarçados conversavam com o suspeito em fóruns privados. Durante os diálogos, o administrador do site mencionou, casualmente, que usava o ChatGPT e ainda colou algumas respostas geradas pela IA, incluindo um poema bizarro sobre o “Y.M.C.A.” em estilo Donald Trump e um pedido para um épico de 200 mil palavras (sim, sério).

OpenAI cedeu os dados?

A resposta oficial da OpenAI ainda está envolta em sigilo, mas sabe-se que a empresa forneceu uma planilha com informações do usuário. Até agora, nenhum dos prompts entregues estava diretamente ligado ao conteúdo ilegal que motivou a investigação, mas o simples fato do governo pedir esse tipo de dado já é suficiente para acender o alerta vermelho.

E não é pouco: entre julho e dezembro do ano passado, a OpenAI reportou ter atendido 71 pedidos governamentais envolvendo 132 contas de usuários.

Identificação do suspeito veio por outro caminho

Apesar do mandado envolvendo a OpenAI, a identificação do suspeito veio de maneira mais “analógica”: por detalhes que ele mesmo revelou nas conversas.

Ele mencionou que já havia passado por avaliações médicas no exército, morado na Alemanha por sete anos e tinha ligações familiares com o Afeganistão. Essas pistas foram cruzadas com dados militares e levaram à identificação de Drew Hoehner, 36 anos, com histórico ligado às forças armadas dos EUA.

Hoehner foi formalmente acusado por conspiração para divulgação de material de abuso infantil, mas ainda não declarou sua defesa.

O que isso tudo revela sobre o futuro das IAs e a privacidade?

Esse caso é um divisor de águas. É a primeira vez que um modelo de IA como o ChatGPT entra oficialmente em uma investigação federal como fonte de evidência ainda que periférica.

Jennifer Lynch, advogada da Electronic Frontier Foundation (EFF), reforçou que o mandado foi pontual, focado em dois prompts. Mas ela também alertou que, estamos entrando em uma era onde o que você digita para uma IA pode ser requisitado por autoridades, da mesma forma que históricos de busca no Google são usados há anos em processos judiciais.

E isso levanta perguntas incômodas:

- Até que ponto os dados do que você escreve para uma IA estão protegidos?

- As empresas de IA deveriam reter o mínimo possível de informações sobre os usuários?

- Será que estamos preparados para a IA deixar de ser uma ferramenta neutra e virar parte da engrenagem legal?

ChatGPT e as investigações sobre crimes

A IA está cada vez mais integrada à vida digital e agora também à justiça criminal. O caso Drew Hoehner e a solicitação à OpenAI mostram que prompts do ChatGPT já deixaram de ser “só conversa” e podem virar prova.

A grande questão não é se a IA deve colaborar com a Justiça é óbvio que sim, especialmente quando vidas e dignidade estão em risco. A pergunta que fica é: estamos prontos para lidar com a responsabilidade que vem ao usar ferramentas tão poderosas?

Porque no fim, a tecnologia é neutra. O uso que fazemos dela esse, sim, diz muito sobre quem somos.