Julho de 2025. A Genians Security Center (GSC) detecta uma nova campanha de spear phishing com uma pegada preocupante: o uso de ChatGPT para criar carteiras militares falsas da Coreia do Sul. Sim, deepfakes gerados por IA agora são ferramentas de espionagem estatal, usadas pelo grupo Kimsuky já conhecido por operar sob as ordens do regime norte-coreano.

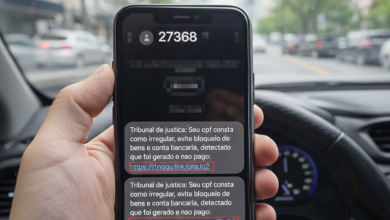

Os e-mails enviados simulavam pedidos formais de emissão ou revisão de documentos de identidade militar. O gancho era convincente, e a peça central do ataque? Um arquivo ZIP com aparência burocrática e um .lnk escondendo comandos PowerShell bem maquiados.

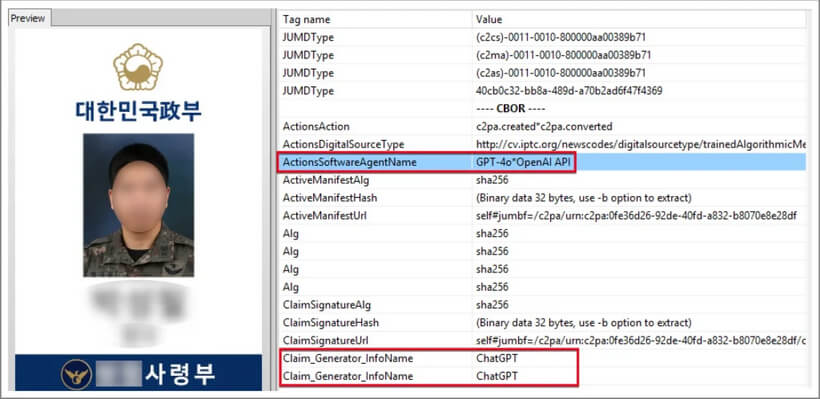

Deepfakes como isca visual no phishing

O arquivo Government_ID_Draft(***).zip continha uma armadilha discreta. Ao abrir, o usuário iniciava uma cadeia silenciosa de execução: o .lnk acionava o cmd.exe, que montava um script a partir de uma string ofuscada. Resultado? Um PowerShell que conectava o host da vítima a um servidor C2, baixando dois arquivos: um batch (LhUdPC3G.bat) e uma imagem de identidade militar.

Essa imagem, gerada por IA, foi flagrada por detectores de deepfake com 98% de probabilidade de falsificação. Detalhe: os metadados confirmaram a assinatura do ChatGPT como origem da criação.

E como cereja do bolo, o batch ainda simulava atualizações legítimas como uma “atualização do Hancom Office” enquanto registrava persistência via Task Scheduler.

Scripts invisíveis e ofuscação por camadas

A sofisticação do ataque não estava só no visual. O .bat e os scripts AutoIt usaram técnicas para passar ilesos por antivírus tradicionais. Um exemplo? Um tipo de cifra rotativa baseada no algoritmo de Vigenère, que embaralhava strings e usava funções dinâmicas para descriptografar os comandos apenas na hora certa.

Além disso, inseriram atrasos de sete segundos nos scripts o suficiente para escapar de muitas soluções sandbox, que só monitoram execução por um tempo limitado. E como se não bastasse, os scripts baixavam arquivos .CAB que, uma vez extraídos, instalavam novas tarefas disfarçadas de atualizações do sistema.

A moral da história? Tudo foi pensado para que a ameaça passasse despercebida por soluções baseadas apenas em assinaturas ou reputação.

Um histórico nada confiável

Essa não foi a estreia do Kimsuky em campanhas criativas. Antes disso, já haviam forjado alertas de segurança usando pop-ups e comandos PowerShell para simular verificações em portais sul-coreanos. E como se não bastasse, segundo a Anthropic, hackers norte-coreanos estão até usando IA para se passar por desenvolvedores em entrevistas técnicas tudo para ganhar dinheiro remoto e driblar sanções internacionais.

Ou seja, a IA virou ferramenta de falsificação, disfarce e infiltração. Não é mais só uma assistente de produtividade. É cúmplice estratégica.

Por que antivírus não serve mais

A grande questão é que esse tipo de ataque desmonta qualquer sensação de segurança baseada em antivírus tradicional. Scripts que se montam dinamicamente, arquivos visuais que parecem reais, tarefas agendadas com nome legítimo… nada disso levanta bandeira vermelha para soluções baseadas apenas em padrão.

O que funciona aqui é EDR plataformas capazes de mapear comportamentos e sequências de ataque. Desde o clique no e-mail, passando pelo script ofuscado, até o contato com o servidor de comando, tudo precisa estar visível para o time de segurança.

Além disso, o EDR precisa enxergar o encadeamento de ações em tempo real, sem depender de um “rótulo de ameaça conhecido”. Não adianta esperar assinatura de antivírus para algo que é praticamente novo a cada execução.

Deepfake como arma estatal

Vale lembrar: carteiras militares são documentos legalmente protegidos. Produzir cópias mesmo parecidas já é crime. Agora imagine isso sendo feito por um estado hostil, com objetivo claro de espionagem. A IA, nesse contexto, não está facilitando a vida de ninguém inocente. Está acelerando o lado mais sombrio da geopolítica digital.

A pergunta que fica é: até onde essa tecnologia vai ser usada para desestabilizar sistemas que dependem da confiança visual?

E você, está preparado para identificar um documento falso gerado por IA? Sua equipe saberia reconhecer uma ameaça que se disfarça de atualização comum? Ou ainda está confiando no antivírus pago que “vem com o pacote”?